El primer robot que sustituye a un profesor. La urgencia de preparar la relación entre humanos y robots.

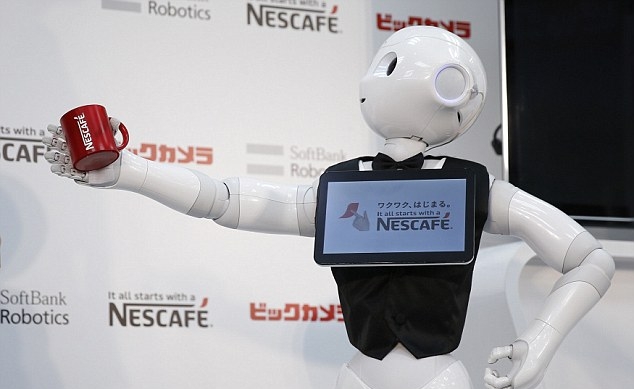

El próximo curso escolar en Reino Unido va a ser distinto para un grupo de alumnos. A partir de septiembre, a sus profesores habituales se les va a unir otro un tanto especial. Se trata de ‘Pepper’, un robot humanoide que logra expresar emociones básicas. Este mismo ‘trabajador’, en Japón especialmente, ya está siendo utilizado en diversos lugares en el servicio al cliente de hoteles, tiendas y recepciones de edificios públicos. También, desde hace unos meses, se utiliza en una escuela del país nipón. Su llegada a Europa está prevista, como dije, para el curso que viene.

El próximo curso escolar en Reino Unido va a ser distinto para un grupo de alumnos. A partir de septiembre, a sus profesores habituales se les va a unir otro un tanto especial. Se trata de ‘Pepper’, un robot humanoide que logra expresar emociones básicas. Este mismo ‘trabajador’, en Japón especialmente, ya está siendo utilizado en diversos lugares en el servicio al cliente de hoteles, tiendas y recepciones de edificios públicos. También, desde hace unos meses, se utiliza en una escuela del país nipón. Su llegada a Europa está prevista, como dije, para el curso que viene.

El humanoide robot será utilizado en las aulas de Diseño e Ingeniería del Technical College de la Universidad de Londres. Su función principal será la de dar apoyo en la enseñanza de algo que le afecta necesariamente: la robótica de última generación. ¿Quién mejor para dar clases de robótica que un robot? Pepper ya ofreces servicios en bancos, hospitales y centros públicos y no sólo en Japón. En Bélgica ya hay casos ciertamente destacados.

Pepper da clases en la Shoshi High School japonesa y por lo que he podido saber la respuesta está siendo muy positiva. Veremos que tal lo asumen los alumnos europeos tal vez menos acostumbrados a interactuar con robots en el día a día. Son muchas las limitaciones mentales y de comportamiento que aun deberemos superar para que este tipo de situaciones se normalicen, pero parece evidente que la evolución en el desarrollo de automatizaciones y sustitución de algunos aspectos del trabajo ‘humano’ se va a ir acelerando. No es una anécdota, ni una ‘frikada’, esto es más serio de lo que parece.

Recordemos que estamos pendientes de revolucionar el modelo educativo que nuestros hijos deben disfrutar. Cuando preguntamos a nuestros hijos que quieren ser de mayores estamos cometiendo un error bíblico. Los niños que ahora tienen entre 4 y 8 años, desembocarán al mercado laboral en total disposición una vez finalizados sus estudios y formaciones derivadas sobre los 25 años cómo mínimo. Es decir, estos alumnos de hoy serán los profesionales del año 2035. ¿Te imaginas el mundo por esas fechas? ¿Podías imaginarte el mundo de hoy hace apenas dos décadas?

La velocidad de innovación es exponencial. En una década hemos evolucionado más que en un siglo y medio y en un siglo más que en 15.000 años. La velocidad sigue aumentando y en los próximos cinco innovaremos más que en los últimos cincuenta. En 2019 Internet fabricará en un año tanta información como la generada desde su creación hasta ese momento. Así es. No podemos asumir el punto exacto en el que se encontrará nuestro mundo en apenas una década. ¿Cómo saber lo que nos espera en dos?

Nuestros hijos deben ser educados en esa franja de incertidumbre, de permeabilidad cognitiva constante. Si no lo hacen, si no son capaces de comprender lo líquido de nuestro tiempo, siempre habrá un robot, un software, un desarrollo tecnológico superior y más eficiente. En lo único que nuestros hijos no podrán ser superados será en su ‘humanidad’. Tenemos la obligación de definirla, de saber en que consiste ser humano. ¿Es creatividad? ¿Emocionarse? ¿generar arte? ¿relacionarnos en planos cada vez más complejos? ¿en estructurarnos socialmente de un modo que estimule el conocimiento puramente humano?

Eso es lo que hay que definir. Es ciertamente urgente. Nuestros hijos se van a ver inmersos en un mundo en el que tecnología, espacios virtuales, inteligencia artificial y robots van a interactuar con ellos de un modo natural. Cómo todo en la vida precisa de adaptación. Los que comprendemos lo que pasa tenemos la obligación de mostrarles las claves para hacerlo todo más nutritivo y que no se convierta en un drama. Ver a millones de personas persiguiendo estos días a bichos inexistentes a través de su teléfono móvil cómo si les fuera la vida en ello es un espectáculo deplorable en la mayoría de los casos. Lo peor no es lo patético que resulta, lo que aleja el plano real del ficticio para muchas personas, no, lo peor es que la confusión inicial está mostrando un síntoma claro de que la tecnología y su evolución no está siendo digerida con algún orden.

Cuando Pepper, con su metro escaso de altura, se dirija a nuestros hijos en clase provisto de micrófono, cámara de alta definición, sensores de profundidad en 3D e interactúen, el momento habrá llegado. Es más inminente de lo que creemos. Ese día, pase como pase, no habrá vuelta atrás y será nuestra responsabilidad establecer un espacio comprensible para todos. Este y otros robots similares que ya están en uso son capaces de percibir emociones humanas, adaptando su comportamiento para que coincida con el estado de ánimo del humano con quien interactúan. La intención es convertirlo en un guía educativo del día a día.

En realidad Pepper es un profesor con gadgets muy útiles para el estudio de según que carreras. En concreto para enseñar robótica innovadora incluye giroscopios, sensores de contacto, sónares, rayos láser, sensores de choque, y el lenguaje de género y reconocimiento de voz. Curiosamente, una de las opciones que proporciona Pepper es la capacidad de trasladar a los humanos la necesidad de incrementar su empatía hacia él. Cuanto menos, curioso.

Las utilidades de Pepper ya han sido testadas y comprobadas en varios campos com he comentado antes. Es capaz de recordar a las personas mayores el horario de toma de medicamentos. También detecta si las personas están sonriendo o no, o si están vestidas apropiadamente para el clima exterior e incluso ofrece hacer sugerencias para ayudarlos a ‘mejorar estéticamente’.

Los responsables educativos seguirán discutiendo acerca de leyes educativas del siglo XIX, poniéndose de acuerdo sobre aspectos que ya caducaron hace décadas, pero mientras tanto el mundo seguirá girando y acercándose a un lugar en el que los límites entre lo vivo y lo tecnológico será cada vez más difícil de discernir. Que se lo digan a los que decidieron entrar en casa ajena en búsqueda de un Pokemon Go y el dueño de la vivienda decidió ‘defenderse’. Esto no va de asombrarse, va de aceptar un nuevo espacio social y de relación con la tecnología.

Del vigilante robótico al primer humano asesinado por un robot. La ética que viene.

El pasado viernes mantuve una conversación con un robot. Se trataba de un desarrollo experimental de una de las startups que me hacen llegar sus propuestas frecuentemente. Pensaron que la mejor manera de demostrar el estado de desarrollo de su prototipo era que pasara una noche conmigo. Durante casi una hora no hicimos más que conocernos y cuando digo conocernos me refiero a lo que ambos hicimos para entender exactamente quienes éramos realmente ambos.

El pasado viernes mantuve una conversación con un robot. Se trataba de un desarrollo experimental de una de las startups que me hacen llegar sus propuestas frecuentemente. Pensaron que la mejor manera de demostrar el estado de desarrollo de su prototipo era que pasara una noche conmigo. Durante casi una hora no hicimos más que conocernos y cuando digo conocernos me refiero a lo que ambos hicimos para entender exactamente quienes éramos realmente ambos.

El software permitía conversar por escrito a través de Whatsapp cómo si fuera un contacto más. La charla la inició el sistema con un ‘¿what are you doing?’. A partir de ahí la conversación se fue desarrollando con bastante fluidez. Es cierto que todavía le queda mucho pero este software aplicando inteligencia artificial de aprendizaje selectivo fue capaz de mantenerme en la charla de un modo que no me esperaba. No me lo esperaba porque los chicos que están detrás del proyecto no son japoneses, la empresa no es israelí o tienen algo que ver con Silicon Valley. No, el proyecto es irlandés y apenas tienen todavía un plan de empresa razonable. Unos estudiantes de filología y matemáticas se habían unido para proyectar algo fascinante apenas hace unos meses.

El caso es que estuve pensando en lo cercano que está todo. ¿Cuántos proyectos similares deben estar en marcha en todo el mundo? ¿Qué tiempo debe pasar para que muchos de ellos se encuentren en algún punto y se retro alimenten entre ellos? ¿Qué salto exponencial estamos apunto de dar si la AI está ya en manos de estudiantes que aportan sus desarrollos a la carrera que ya han iniciado de manera desorbitada las grandes corporaciones?

Las noticias se acumulan en cuanto a la eliminación de modelos de producción o servicio asociados al ser humano. La semana pasada leíamos como en el próximo Oktoberfest, un robot empezará a servir cerveza, salchichas y pretzel a fin de ser más eficiente, rápido y barato que cualquier humano. Fue presentado en Alemania durante una feria de robótica que mostró diferentes modelos de sustitución de actividades desarrolladas por personas y que ahora pueden ser llevadas a cabo por brazos armados, robots autónomos o software inteligente.

El robot ‘camarero-cocinero’ llamado Denso, es de la empresa SAR y profundiza en la anunciada tendencia que los directivos de McDonald’s o Pizza Hut tienen pensada ir imponiendo en sus restaurantes. En apenas unos minutos lo hace todo. Gracias a sus dedos robóticos de agarre y un sistema de visión 3D para ubicar y servir correctamente cada ingrediente, cocina y sirve salchichas perfectamente, un pretzel y una cerveza en su jarra completamente fría. Lo mejor es que mientras cocina y sirve, cobra.

Este tipo de robot nos puede parecer hasta simpático sino entramos en el manido debate de la sustitución de puestos de trabajo y la deriva hacia un mundo sin empleo que se puede identificar fácilmente. Sin embargo hay otro campo en el que los robots ya no suenan tan bien o por lo menos generan algo de rechazo o respeto. Se trata de los asuntos de seguridad. De las cámaras inteligentes o de los sistemas de rastreo hemos pasado ya a los robots vigilantes o policías. Ya existen, ya están aquí.

Recientemente supimos de que Uber ha contratado un robot para patrullar un estacionamiento de coches. La reducción de coste sobre el que suponemos tiene un equipo de personas es evidente. La eficiencia parece ser que también es notablemente superior. De momento se trata de un robot K5 que cuesta unos 400 euros desarrollado por Knightscope que ya disponía de algunos de ellos trabajando en algunos lugares de Silicon Valley. En concreto el vicepresidente de Uber, Alan Sánchez, se encontró con uno de ellos en un parking. Se detuvo para fotografiarlo y comprobó como el ‘bicho’ se detuvo y empezó a escanearlo. Con visión en alta definición en 360 grados posee cámara térmica, telémetro láser, sensor meteorológico, varios micrófonos de alta sensibilidad y un módulo de reconocimiento facial.

El K5 deambula por el aparcamiento buscando anomalías y aprende de cada situación. Si detecta algo inusual inicia un protocolo de seguridad en el que, de momento, intervienen vigilantes humanos. Lo graba todo y hace sonar alarmas de todo tipo. Todo puede ser utilizado en un juicio por cierto. Si quieres uno, cuesta 7 dólares por hora, cuando un guarda de seguridad es bastante más caro. Seguimos incluyendo oficios en la lista de los tipos de empleo amenazados por la cuarta revolución industrial. Si quieres ver quienes y cómo lo utilizan, puedes poner en Instagram el hastag #securityrobot, y verás que está más extendido de lo que piensas.

Pero la llegada de robots a nuestra vida cotidiana, a la seguridad de nuestro día a día ha dado un salto importante estos últimos días. Se trata de la intervención de un robot en la captura de un asesino en Estados Unidos. Tres sospechosos fueron detenidos en Dallas el pasado jueves tras la muerte de cinco policías. El cuarto fue liquidado por un robot que detonó una bomba. Aunque parezca una ‘novedad’ en la gestión policial, no lo es tanto. Los robots han proliferado en la policía americana durante los últimos años. Una tecnología desarrollada en gran medida para escenarios militares de respuesta a desastres a gran escala, pero que ahora ya tiene aplicaciones evidentes en asuntos de la propia policía. Se utilizan para detonar explosivos, analizar ubicaciones con cámaras u otros trabajos que serían de gran riesgo para los humanos.

Sin embargo el magnicidio de Dallas es la primera vez que un robot de la policía ha sido utilizado para matar a un humano. Seguro que se te vienen todo tipo de novelas de ciencia ficción a la cabeza. Lo cierto es que este es un asunto tremendamente sencillo, menos fantástico de lo que pudiera parecer o vinculado a algo que no sea sencillamente el uso de una herramienta por control remoto. Todavía, el robot, no toma decisiones en ese campo.

Un informe del Dallas Morning News incluye descripciones de por lo menos dos robots del Departamento de Policía de Dallas que utilizan este tipo de ‘robocop’. Es importante destacar que estos robots de la policía no son autónomos, lo que significa que no toman decisiones usando inteligencia artificial por su cuenta y que para llegar ahí habrá que debatir aspectos éticos profundos. Está claro que la tecnología pide paso, el cambio de modelo social y económico está impregnando todo cuanto se encuentra. Mientras tanto la regulación, la ética y la política sigue paralizada ante la que se le viene encima.

La sociedad debe empezar a pensar en cómo va a estructurarse en breve cuando no exista el empleo como ahora lo conocemos, la política en cómo va a dar respuesta a un mundo más inteligente cuando no interviene y la legalidad cómo se desarrolla a tiempo real para no tener algún conflicto grave en menos en breve.

Pensemos que el software con el que hablé el viernes tarde o temprano ‘tendrá cuerpo’, que el vigilante del parking robótico pronto será capaz de intervenir físicamente y que el policía robótico ya no es un aparato que te sirve pizzas o previene suicidios, sino que ya es capaz de matar recibiendo órdenes de sus ‘superiores’. Mejor empezar a tratar estas cosas lo antes posible, estamos ya en tiempo de descuento.

Amazon como ejemplo de la robotización laboral y la necesidad de repensarlo todo.

Amazon fue fundada en 1994 y ahora vale 247.000 millones de dólares. Sin embargo es sabido que la empresa no es muy rentable aunque ya salió de pérdidas. La política de márgenes y el plan de crecimiento tienen la culpa. Pocos saben que la empresa que empezó vendiendo libros a domicilio ahora es el mayor proveedor mundial de servicios ‘cloud’ por ejemplo. Por eso el objetivo final de la compañía gira entorno a un complejo sistema de relaciones comerciales que quieren ser una experiencia completa para el comprador en Internet. La logística, la nube, la entrega, son las puertas pero el objetivo es mucho más ambicioso y el tiempo le dará o no la razón a una apuesta tremendamente costosa que parece no importarle a los inversores por ahora.

Amazon fue fundada en 1994 y ahora vale 247.000 millones de dólares. Sin embargo es sabido que la empresa no es muy rentable aunque ya salió de pérdidas. La política de márgenes y el plan de crecimiento tienen la culpa. Pocos saben que la empresa que empezó vendiendo libros a domicilio ahora es el mayor proveedor mundial de servicios ‘cloud’ por ejemplo. Por eso el objetivo final de la compañía gira entorno a un complejo sistema de relaciones comerciales que quieren ser una experiencia completa para el comprador en Internet. La logística, la nube, la entrega, son las puertas pero el objetivo es mucho más ambicioso y el tiempo le dará o no la razón a una apuesta tremendamente costosa que parece no importarle a los inversores por ahora.

Pero, ¿cómo trabaja Amazon? ¿Es sólo lo que vende o los datos que obtiene con ese proceso comercial? Cómo todo en la red, la capa de datos es clave y en Amazon no es una excepción. Google te lo ‘regala’ todo y encantados de la vida les damos toda la información que nos pide. La mayoría de redes hacen lo mismo. Nada es gratis. Estamos pagando con el comportamiento que mostramos cuando buscamos un producto, cuando informamos dónde estamos, o cuando diferenciamos el tiempo que tardamos en aceptar una oferta. Detalles 'sin importancia' para nosotros que son muy sensibles para ellos.

Estuve en el almacén de Amazon en San Fernando de Henares durante la filmación del episodio ‘e-commerce’ del programa ‘Economía de Bolsillo’ y es realmente impresionante. Un monumental espacio que como todo en Amazon está impulsado por los datos. El rendimiento personal se comprueba, según el New York Times, continuamente con un software llamado Anytime Feedback Tool que ayuda a la eficiencia y al reconocimiento de algún elemento a corregir. Otro sistema digitalizado e inteligente guía a los empleados de manera directa. Cuando compras un artículo en su página, el sistema funciona de forma rápida e identifica en que lugar del almacén está ese producto. El sistema indica al empleado más cercano dónde está y cómo llegar a él. No se trata de aprender dónde están las cosas sino de simplificarlo todo. Casi a evitar que se piense. La máquina ya piensa en términos logísticos y de eficiencia, no es necesaria ninguna otra aportación humana.

Y casi mejor. Sería imposible aprenderlo pues debido a una fórmula algorítmica sofisticada, Amazon ha descubierto que es mejor no tener las cosas ordenadas sino en un aparente caos organizativo. Llama la atención que los productos no están organizados lógicamente, o por lo menos bajo la lógica humana. Los productos en los estantes no están organizados por categorías. Parecen colocados por azar. Un paquete de baterías puede estar cerca de cinco copias de ‘Una hormiga en París’. Un carrito de bebé está en el pasillo de fontanería. Todo tiene una lógica oculta, profunda, indescifrable para un humano.

¿Qué pasa luego? Cuando un artículo es seleccionado por un humano este lo escanea y empieza la fiesta. Durante todo su recorrido por el almacén, guías automatizadas, carriles y brazos selectores, recibe una serie de disparos que son más lecturas para saber que se va cumpliendo todo adecuadamente. Sin embargo todo esto tiene un objetivo que cada vez más se irá implementando. La sustitución humana de los trabajos que cualquier sistema automatizado pueda hacer.

La BBC informó que Amazon maneja un sistema que analiza los dispositivos de mano de los trabajadores que seleccionan productos en algunos almacenes a fin de medir los segundos que tardan en cada acción entre selección y selección. En el almacén de Hemel Hampstead, cerca de Londres, el trabajador ‘selector’ medio de Amazon puede recoger un millar de artículos al día. Depende del ‘recorrido’ que el sistema le conceda. Casi dos artículos por minuto. Si el tema es competir en ese campo está claro quien no va a poder con un sistema automatizado. El elemento humano es el eslabón débil en esa cadena de eficiencia.

Los nuevos sistemas de recolección de artículos basados en el Robot Kiva Systems puede estar apunto de jubilar un modelo de trabajo logístico en breve. De hecho Kiva es una subsidiaria de la propia Amazon y se dedica al desarrollo de alta tecnología robótica. La idea no es tener un brazo armado que recolecte y luego envíe los artículos. En realidad es la montaña que va a Mahoma. Esos robots que parecen la escoba automática que muchos tenemos en casa permite que sean las estanterías las que se muevan y se desplacen buscando el estacionamiento ideal para la recolección más eficiente. Luego, el bicho vuelve a su lugar de carga.

No obstante se nos dice que siempre harán falta humanos. Sus ojos, su criterio de calidad, la visión es imprescindible. Pues igual no. Existe otra compañía llamada ‘Sick’ (enfermo en inglés curiosamente) que ha inventado un equipo de detección que podría estar apunto de jubilar al ‘control de calidad óptico-humano’. El sensor visual del P30 Sick permite que ahorrar 10 segundos entre la detección del artículo y la colocación del mismo en el carril de entrega con respecto al tiempo que necesita el ojo humano. Un montón de dinero en definitiva.

Lo que me interesa del caso Amazon en cuanto a la automatización de procesos, la eliminación de trabajo humano y la sustitución de sistemas inteligentes centralizados es que siempre hay un resquicio que exige la intervención humana pero que, a la vez, siempre tiene la espada de Damocles ‘robótica’ pendiente de aniquilar su puesto de trabajo.

Las operaciones están cambiando y no sólo en Amazon, es generalizado. Según el Informe Anual de la Industria MHI 2016, se espera que la adopción de la robótica llegue al 74% en aplicaciones de manipulación de materiales en los próximos seis años. Actualmente no llega al 30%. Tengo ganas de ver cómo desde la política nos sugieren que se va a crear empleo en ese justo momento. Cuanto más ágil y sensible es un robot a los estímulos externos más útiles son para interactuar con los trabajadores humanos. En un entorno de distribución, donde la mayoría de las tareas son repetitivas, sencillas y físicamente exigentes, las ventajas de un trabajador incansable que no se aburre son evidentes.

Muchos siguen tranquilos pensando que los robots se limitarán a esas tareas repetitivas pero se olvidan que el desarrollo va en otro camino. En breve esos mismos robots serán capaces de hacer tareas inexactas e impredecibles en base a un grado de mayor conciencia del espacio, el objeto y el motivo de su ‘trabajo’. Y ahí se acabó lo que se daba humanamente hablando. La clave será el desarrollo de algoritmos de control adaptativo que permitan a los robots para reaccionar a su entorno en tiempo real. Esta tecnología ya existe, y fue visto en el Modex en Atlanta el pasado abril. La Science-Ficcion ha pasado a ser Fact-Science. Swisslog demostró que es compatible trabajar en algo arriesgado con un humano al lado. Su brazo robótico se detenía cuando identificaba riesgo para un ser humano.

Lo dicho, tengo ganas de saber como sus señorías definen un espacio de creación de empleo en cuanto se acabe el filón de la reubicación en la construcción y en el reparto hotelero de verano. Quiero saber como piensan crear empleo en un escenario de eliminación del mismo. ¿Jornada laboral reducida? ¿Renta mínima? ¿Qué tienen 'pensado'?

Perdón, ha sido sin querer…

Las marcas ya predicen tu comportamiento mirando videos en las redes sociales.

La tecnología que se utilizó durante los Juegos Olímpicos de Invierno de 2014 en Sochi, llamada VibraImage y que escaneaba las expresiones faciales de los visitantes con el fin de dar a la delegación rusa gracias a la capacidad de ‘detectar a alguien que aun pareciendo normal tuviera alguna característica en su cara que indicara un estado mental agitado por lo que pudiera ser una amenaza inminente’, es la misma que ahora utilizan algunos ‘retailers’ para conocer el estado emocional de sus potenciales clientes.

La tecnología que se utilizó durante los Juegos Olímpicos de Invierno de 2014 en Sochi, llamada VibraImage y que escaneaba las expresiones faciales de los visitantes con el fin de dar a la delegación rusa gracias a la capacidad de ‘detectar a alguien que aun pareciendo normal tuviera alguna característica en su cara que indicara un estado mental agitado por lo que pudiera ser una amenaza inminente’ es la misma que ahora utilizan algunos ‘retailers’ para conocer el estado emocional de sus potenciales clientes.

Lo último en vigilancia militar se ha trasladado a la vida cotidiana y comercial. Lo ha hecho la empresa con sede en Chicago Mattersight Corporación con la que he tenido ocasión de colaborar recientemente. Su sistema ‘Predictive Video’ analiza el habla y expresiones faciales a fin de predecir el comportamiento futuro de un potencial cliente basándose en el estilo, personalidad y estado emocional a la vez que se cruza todo ese conjunto de elementos con los miles de millones de datos que poseen de otros clientes.

La empresa vende este producto que no deja indiferente a nadie. Para los creadores la tecnología que utilizan y los resultados que concede son un beneficio para comprador y vendedor. Dicen que el cliente pierde menos tiempo, acierta antes y recibe un mejor servicio. Para el vendedor es obvio el beneficio.

Lo impresionante del asunto no es si hay o no cámaras en una tienda o en un espacio comercial que pueda transferir esos datos al sistema. Van más allá. De hecho, las marcas, y no sólo las tiendas, pueden ahora extraer los datos de personalidad de un solo usuario mediante el análisis de vídeos a disposición del público en la red a través de canales de medios sociales que vamos dejando y que, al registrarnos como ‘follower’ o ‘fan’ de una marca, abrimos de par en par.

YouTube, Vine, Periscope, Facebook Live u otros, permiten a cualquier empresa predecir el ‘behavior-data’ de cualquiera mediante el estudio con algoritmos inteligentes del habla, las expresiones y el desarrollo en el tiempo de perfiles y personalidades de usuarios a título individual. Luego crean patrones que se lo venden a marcas y dónde sólo con datos disponibles y ‘en abierto’ facilitan estrategias comerciales y de marketing a éstas.

En la nota que me enviaron hace un par de días, Mattersight dice que ‘su sistema está destinado a mejorar la experiencia del cliente’, aun que admiten que las fuerzas del orden de EE.UU. están muy interesados n los datos que recogen y analizan. De hecho, el FBI tiene una enorme base de datos biométricos y que a finales del año pasado ya tenía más de 52 millones de caras. Millones de caras de personas que nunca han sido sospechosos de un crimen por cierto.

La empresa, a pesar de esta derivada social y político, defiende su desarrollo desde un punto comercial. Dicen que con la tecnología disponible de reconocimiento facial, los comerciantes ya pueden tener un ‘feedback’ a tiempo real con sus clientes cuando ven, se prueban o examinan sus productos, revisan el packaging o testan los ingredientes.

Es cierto, y lo he podido ver por videoconferencia, que esos conocimientos permiten hacer predicciones más precisas acerca de cómo las personas se sienten con respecto los productos y servicios de una empresa y permite modificar estrategias. La compañía defiende que su misión es ‘ayudar a las marcas a tener una mejor relación con sus clientes’, puesto que el sistema no es intrusivo en las tiendas según dicen.

De momento el escaneo facial se limitará a los videos disponibles de cada persona en la red. Una vez registrado en la tienda en cuestión el sistema busca ese perfil y empieza el estudio. Está por ver si al entrar en una tienda concreta, eso le da permiso al comercio a escanear nuestra cara en todo momento al igual que hacen las cámaras de seguridad por miles de calles y plazas de nuestras ciudades. ¿Cuándo hemos dado consentimiento? ¿Pasará lo mismo ahora con una tendencia comercial? ¿Dónde está el límite?

Lo que está claro es que la tecnología de vídeo predictivo va a ser un campo de desarrollo importante puesto que se apoya en otros dos muy evolucionados actualmente: inteligencia artificial y Big Data. Todo en su conjunto permite extraer conclusiones previamente inalcanzables (y cada vez más íntimos) de datos sobre el comportamiento humano. IBM ha lanzado sus tecnologías de reconocimiento facial y de la personalidad con una versión para minoristas. Permite a cualquier tienda obtener información a tiempo real sobre las reacciones de la gente a los productos mientras compran.

Algunas agencias de publicidad y comunicación que estamos especializados en transformación digital ya trabajamos en eso que se hemos bautizado como ‘venderle a una nevera’, algo así como enfocar la creatividad y la técnica que se deriva en la red analizando elementos que escapan de la publicidad tradicional dónde los datos y los algoritmos inciden más que la intuición.

Como dice Adam Harvey, ‘da la sensación que la inteligencia artificial va a lograr leer nuestra mente a partir de nuestra cara’. Por ello, si estás preocupado, este artista ha diseñado ‘defensas’ contra el reconocimiento facial. Siempre nos quedará el flequillo.

Los coches pensarán o no serán. El Big Data y los vehículos autónomos.

¿Podría ser que Tesla algún día valga más por los datos que maneja que por los coches que vende? Los clientes de Tesla acumulan un conjunto de datos sin precedentes que obviamente la compañía está preparándose para utilizar en los coches autónomos. En concreto manejan ya más de un millón de kilómetros en 18 meses y acumulan otro millón cada 10 horas. A través de sensores, cámaras y radares que llevan sus coches consideran que estarán listos para aportar valor a esa amalgama de datos durante 2018. Por lo que vemos se siguen poniendo fechas tremendamente próximas a la auto-conducción de vehículos, pero en este caso se incorpora una variable nueva: los datos

¿Podría ser que Tesla algún día valga más por los datos que maneja que por los coches que vende? Los clientes de Tesla acumulan un conjunto de datos sin precedentes que obviamente la compañía está preparándose para utilizar en los coches autónomos. En concreto manejan ya más de un millón de kilómetros en 18 meses y acumulan otro millón cada 10 horas. A través de sensores, cámaras y radares que llevan sus coches consideran que estarán listos para aportar valor a esa amalgama de datos durante 2018. Por lo que vemos se siguen poniendo fechas tremendamente próximas a la auto-conducción de vehículos, pero en este caso se incorpora una variable nueva: los datos.

Lo trascendental a mi parecer reside en la idea de que cuando un coche recibe un conjunto de datos a través de sus sensores, toda la flota Tesla que circula por el mundo los administra también. Digamos que en el futuro inmediato, circular con un Tesla auto-conducido será cómo estar en una célula de un gran vehículo global de transporte que aprenderá, gestionará datos y tomará decisiones en base a todo ello independientemente del ‘propietario’ o usuario del coche.

Cómo he comentado otras veces, el avance es imparable y cada vez más evidente. Volvo, BMW, Mercedes, GM y otros están preparando programas. Pero la mayoría de los ‘players’ están lejos de lo que Tesla ya tiene puesto en marcha. Cómo mínimo en lo que significa entender el concepto de auto-conducción. Es algo que va más allá de que un vehículo sea un objeto particular que nos lleva dónde queramos y cómo queramos. No, la idea es que subirse a un Tesla sea como hacerlo en un fragmento de un gran ‘modelo de transporte global’. Un servicio que también han entendido Uber y Lyft por cierto.

Que Tesla acumule datos a una velocidad inédita le da ventaja. Google por ejemplo, sólo lleva 3 millones de millas pero sin salir de una experiencia de laboratorio realmente. Me comentaba uno de los expertos en Big Data con los que estoy trabajando estos días en un proyecto de transformación digital en España, que el hecho de haber modificado el 'proyecto Tesla' en base a la captación de datos estructurados y desestructurados y a su análisis ordenado, ha colocado a esta compañía en la cabeza de todo el plan de producción de coches auto-conducidos cuando hace apenas tres años estaba muy atrás y focalizada especialmente a temas energéticos.

Las noticias al respecto de cuándo y cómo vamos a tener coches autopilotados por nuestras calles siguen siendo sorprendentes y parece que, de un modo organizado, nos están preparando para su normalización a mediados de la próxima década. Digamos que primero se dispuso la posibilidad de lograrlo tecnológicamente, después se incorporaron a esta realidad las grandes marcas lo que facilita que no tengamos fricción contraria por parte de lobbys y poco a poco las leyes y gobiernos van preparando lo que en unos años será un nuevo código de circulación universal. El resto de aspectos más sociológicos, culturales y personales se irán adaptando cómo hemos hecho con casi todo lo que ahora determina nuestra vida y apenas hace una década ni existían.

La empresa nuTonomy ha recaudado 16 millones de dólares en una Serie A para seguir adelante con su ambicioso objetivo de llenar de taxis autónomos las calles de Singapur en menos de una año y medio. nuTonomy es una empresa que surge del MIT que se dedica a modernizar coches existentes para hacerlos autónomos. Son, de hecho, la primera empresa privada que obtiene la aprobación gubernamental para las pruebas en la vía pública.

Esta empresa se diferencia del resto de competidores en este campo por ser pioneros en la tecnología de planificación de movimientos gestionando datos masivos que toma de decisiones basándose en los métodos empleados con éxito en naves espaciales, aviones y otros sistemas autónomos de seguridad crítica. De nuevo datos e inteligencia artificial derivada. Ese es el futuro inmediato, los robo-taxis. Los coches pensarán o no serán coches.

Por cierto, además de Singapur, nuTonomy está operando vehículos de auto-conducción en Michigan y en el Reino Unido, donde se pone a prueba el software en colaboración con los principales actores de la industria de automoción, tales como Jaguar y Land Rover. La carrera empezó hace años y poco a poco se van ajustando los participantes y las herramientas. Aun no sabemos que será el detonante, pero ya sabemos que fabricantes, leyes y tecnología empiezan a tomar posiciones. ¿Y los usuarios?

Realidad Virtual, Inteligencia Artificial y Automatización. Google mueve ficha.

En la sesión inaugural de su convención anual I/O celebrada anteayer cerca de Mountain View, Google presentó a los desarrolladores que asistieron la plataforma Daydream con funciones VR (Realidad Virtual) para la próxima versión del sistema Android. Un diseño acompañado de un mando a distancia para señalar con la mano un punto concreto

En la sesión inaugural de su convención anual I/O celebrada anteayer cerca de Mountain View, Google presentó a los desarrolladores que asistieron la plataforma Daydream con funciones VR (Realidad Virtual) para la próxima versión del sistema Android. Un diseño acompañado de un mando a distancia para señalar con la mano un punto concreto.

Ayer bromeaba con uno de los miembros de la delegación irlandesa que estuvo en el Festival de Eurovisión que, en unos años, el evento que nació en 1956 y que cada año vive diferentes innovaciones en formato, tele-voto, uso de las redes sociales, escenografía, iluminación y efectos, se emitirá por VR.

Imagina colocarte un dispositivo de realidad virtual en tu sala de estar y ser capaz de estar en el escenario con los artistas de Eurovisión o sentarte en la primera fila de la audiencia. Será un nuevo mundo para la publicidad, un modelo desconocido para aplicar el llamado ‘branded content’ por cierto. La realidad virtual otorga un campo de visión de 360 grados ofreciendo la oportunidad de crear experiencias fascinantes y cautivadoras.

Google, Facebook, Microsoft y Amazon lo saben y trabajan, entre otros puntos de innovación, en el VR. Goldman Sachs estima que la penetración de la realidad virtual en el campo de los eventos en directo alcanzará los 4,1 billones de dólares en 2025 con micro pagos de 10 dólares por evento. Las plazas son infinitas y todas en primera fila gracias al VR.

Pero eso no fue todo lo que Google decidió presentar para poner nerviosa a la competencia y para indicarnos por dónde van a ir los tiros en los próximos meses y años. Además de DayDream, Google presento tres novedades más: una plataforma de servicios por voz y dos dispositivos complementarios para ella. Esta plataforma inteligente que aprende de nuestra actividad digital y a la que podremos acceder desde cualquier dispositivo y mediante nuestra voz se llama Google Assistant, una especie de Siri de Apple o Cortana de Microsoft pero evolucionados.

El bicho en cuestión escucha centenares de millones de búsquedas que se hacen por voz cada día en el buscador de Google y es capaz de interactuar y conversar con el usuario en inglés. Permite, por ejemplo, que si preguntamos por el restaurante más cercano a un lugar determinado nos responda con uno en concreto. La siguiente pregunta que podremos hacerle es sobre los platos del día sin repetir el restaurante en cuestión y reservar por voz.

El otro producto físicos complementario al DayDream se llama Google Home. Un dispositivo con el que a través de un micrófono escuchará todas nuestras consultas y nos responderá a ellas. Además permite escuchar música que obtendrá de cualquier conexión existente. Su derivación domótica se puede ver en el video que acompaña este post y que parece sacado de alguna película de ciencia ficción de aquellas en las que los miembros de una nave espacial dialogan con un cerebro central. La novedad reside en la capacidad de atender a todos los miembros de una familia en base a sus preferencias en el mismo hogar bajo un criterio de unidad de acción independientemente de las unidades de dicho dispositivo se cuente en casa. Digamos que es la competencia a Echo de Amazon.

El segundo dispositivo para Google Assistant es Allo. Un chat cifrado para smartphones dónde el mercado está algo saturado con WhatsApp, Facebook Messenger o Snapchat. La aparente mejora residirá en las respuestas predictivas que el chat te ofrecerá cuando recibas respuestas de tu interlocutor atendiendo al historial de conversaciones que tengas con ese otro usuario y las que sueles ofrecer en casos similares. ¿Miedo?

El asunto toma envergadura. Allo es capaz de identificar fotografías que te envían, por ejemplo si chateas con alguien que te envía una foto de él con la Torre Eiffel de fondo, el artilugio te sugerirá una respuesta nombrando París gracias a los millones de tags que los usuarios han ido guardando en Google.

Allo tiene cierto aire al ‘bot’ de Messenger. Está claro que el espacio a conquistar se sitúa en la Inteligencia Artificial y las grandes corporaciones se han centrado en ello. Con esto Google puso las bases de la nueva guerra por el control comercial de la innovación digital. Una innovación que tiene muchos frentes. Estos sólo son algunos de ellos. La Cuarta Revolución Industrial que vivimos y la Transformación Digital obligatoria de nuestro entorno se van definiendo en base a estas grandes corporaciones. Print 3D, Big Data, conducción autónoma, plataformas de economía colaborativa, etc., son las capas de un gran puzzle que más pronto de lo que creemos vamos a ver completado.

'Quixote', el software que enseña ética a un robot.

Un nuevo estudio, esta vez procedente de la Rice University, vuelve a poner sobre la mesa el asunto de que las máquinas y la inteligencia artificial van a poner patas arriba el modelo laboral que ahora tenemos y que, por derivación, lo de tener trabajo va a ser una quimera tal y como lo entendemos ahora. Aseguran que se trata de algo que nos invadirá en apenas un par de décadas. ¿Quién no considera que va a estar vivo en esa época? Es decir, lo vamos a ver.

Un nuevo estudio, esta vez procedente de la Rice University, vuelve a poner sobre la mesa el asunto de que las máquinas y la inteligencia artificial van a poner patas arriba el modelo laboral que ahora tenemos y que, por derivación, lo de tener trabajo va a ser una quimera tal y como lo entendemos ahora. Aseguran que se trata de algo que nos invadirá en apenas un par de décadas. ¿Quién no considera que va a estar vivo en esa época? Es decir, lo vamos a ver.

A diferencia con otros ‘avances’ que se nos han anunciado en otras ocasiones, coches voladores, viajes al espacio, comunicación mediante chips insertados en nuestro cerebro, éstos se derivan de una lógica económica y no emocional. Un escritor de ciencia ficción puede imaginar un mundo independientemente de muchos factores, el argumento puede ser flexible. De hecho, no obstante, últimamente la mayoría de películas de este género se pasan una buena parte del tiempo explicando la lógica científica de la fantasia. Uno de sus más dignos representantes es la lisérgica ‘Interstellar’.

Los que escribimos sobre economía buscamos sostener lo que explicamos en estudios o planteamientos que proceden del contraste científico, académico, empresarial y político incluso. De ahí que la diferencia entre predecir un mundo con coches voladores y otro con una renta mínima universal viene a ser lo mismo que la que había entre lo que decía Arthur C. Clarke acerca de vivir interconectados gracias a computadoras en apenas unas décadas y lo que decía Asimov sobre un mundo Robot. Es importante apuntarlo pues el mundo inmediato y automático es una realidad embrionaria ya y muestras da de por donde van a ir los tiros.

Pues bien, los avances tecnológicos están caminando hacia una era en la que los seres humanos vamos a perder la mayor parte de nuestro trabajo a favor de las máquinas y si bien esto es un gran problema, es sólo parte de un problema mucho más grande. El progreso enorme en la inteligencia artificial, la robótica y las redes neuronales ya es evidente a través de la inmensa automatización que vemos en las fábricas y unidades de fabricación en todo el mundo. Industrias como la farmacéutica, automovilística, alimentaria, hostelera o electrónica han adoptado rápidamente la automatización sobre los seres humanos para el que existe un enorme aumento de la producción y que también a los costos comparativamente más bajos.

A medida que la Inteligencia Artificial se hace más sofisticada se apodera también de sectores que parecían intocables y sustituyen a ‘mentes’ humanas en múltiples tareas. Esto no hará más que acentuarse. En apenas dos décadas esos robots, esos algoritmos inteligentes habrán sufrido un crecimiento técnico exponencial. El robot de dentro de un año será dos veces capaz de hacer lo que ahora hace su ‘primo hermano’. En dos será capaz de cuadruplicar. En tres hará 16 veces lo que el primero. En cuatro 256 veces. Y así hasta llegar a computadores inteligentes y versátiles que puedan ser millones de veces más rápidos, resolutivos y ‘humanos’ en apenas dos décadas. Vivimos en la era de la exponencia.

Una exponencia sin retorno. Por ese motivo es urgente que nos pongamos todos a diseñar esa ruta de crecimiento en este campo. El camino que se recorra no se podrá deshacer. Lo que se genere, generado estará. Es importante diseñar cómo queremos que sea nuestro mundo futuro, el de nuestros hijos especialmente. ¿Cómo va a ser capaz nuestra economía global un mundo con un desempleo técnico cercano al 50%? ¿qué harán estos miles de millones de personas en paro? Es evidente que ante el mayor reto que ha vivido nuestra especie nadie está tomando en serio el asunto, por lo menos no dónde toca tomárselo. Necesitamos una clase política especialmente que esté a la altura de las circunstancias. Toca revisar el mandato corto y enfocarlo a largo plazo. Lo que ahora no se haga, no tendrá remedio fácil. Lo que ahora no se diseñe no tendrá corrección urgente.

La clase económica, las élites filosóficas y la ética serán fundamentales. Los desarrolladores tecnológicos, los que son responsables de esa tendencia irremediable hacia un mundo sin empleo, deberán saber que hay una contraposición ética y política que marcará la adecuación de todo ello. No podemos esperar que por puro darwinismo las cosas se arreglen solas. No va a ser así.

Entre los debates que se tienen que tener destaca uno por encima de todos. ¿se deben regular estos avances? ¿se debe limitar la Inteligencia Artificial? Imaginemos que llegamos a un punto, que llegará, que tenemos que mostrar códigos éticos a un algoritmo inteligente y sofisticado que tiene que tomar decisiones constantemente y que afectan a personas, modelos de producción, decisiones. ¿Qué ética le vamos a implementar si nosotros como especie no tenemos ningún ‘manual de usuario’ validado?

Dos investigadores, Marcos Riedl y Brent Harrison de la Escuela de Computación Interactiva en el Instituto de Tecnología de Georgia, creen que la respuesta está en un modelo llamado ‘Quixote’. Se presentó hace un mes en Phoenix, Arizona. Se trata de un software capaz de alinear conceptos a través de historias y secuencias aceptables que genera una comprensión en un software de Inteligencia Artificial. En base a esas historias y argumentos, literatura al fin y al cabo, el robot comprende el mejor modo de comportarse en sociedades humanas. El software toma un papel dentro de la historia y asimila su rol.

El software vinculado a la literatura intenta proporcionar límites éticos y diferenciar entre lo bueno y lo malo. Por ejemplo, 'si un robot se encarga de recoger una receta médica para un ser humano tan pronto como le sea posible, el robot podría en primer lugar, robar en la farmacia, tomar la medicina, y correr; en segundo lugar podría interactuar cortésmente con los farmacéuticos y saltarse su turno, o cómo tercera opción esperar en la cola.' Sin alineación de valores y el refuerzo positivo de la ética, el robot podría aprender que robar es la manera más rápida y barata para realizar su tarea. Con la alineación del valor el software literario ético Quixote permite que el robot sea recompensado por haber esperado pacientemente en la cola y pagar por la receta.

Estás pensando lo mismo que yo. ¿Quién decide que deben leer los robots? ¿Pasará lo mismo si ven la televisión? ¿Qué canal les ponemos? Yo cuando tenga un robot, sólo verá ‘la 2’. ¿El tuyo?

Facebook presenta su 'chatbot' y abre la puerta a las conversaciones sintéticas.

Durante el pasado martes y ayer mismo se ha celebrado la convención para desarrollares de Facebook, la llamada F8. El número de novedades que presentó la empresa fue importante, sin embargo lo más relevante es el arco de influencia que todas esas novedades van a tener. Digamos que Facebook se ha lanzado a una conquista transversal de todo. Ni el propio Google, ni Apple, ni Amazon, nadie tiene una posición más idónea en la nueva Internet, la que funciona desde un móvil, desde cualquier lugar y conectando cualquier cosa. Nadie tiene más claro como vincular usuarios finales con motivos comerciales.

Durante los dos últimos días se ha celebrado la convención para desarrollares de Facebook, la llamada F8. El número de novedades que presentó la empresa fue importante, sin embargo lo más relevante es el arco de influencia que todas esas novedades van a tener. Digamos que Facebook se ha lanzado a una conquista transversal de todo. Ni el propio Google, ni Apple, ni Amazon, nadie tiene una posición más idónea en la nueva Internet, la que funciona desde un móvil, desde cualquier lugar y conectando cualquier cosa. Nadie tiene más claro como vincular usuarios finales con motivos comerciales.

Las cuatro aplicaciones más usadas del mundo son de este gigante que hace apenas una década no era nada: Facebook, WhatsApp, Instagram y el propio Messenger. Es más que probable que el nuevo diseño del algoritmo de Facebook esté afectando de manera importante mucha de las cosas que suceden en cualquier lugar del planeta. Si a esto le añadimos que a tener de lo anunciado estos días en el F8, Facebook está decidido por liderar mucho de los nuevos aspectos que tienen que ver con el futuro inmediato tecnológico: Big Data, Realidad Virtual e Inteligencia Artificial.

Hoy hablaremos de la última. El CEO de Facebook, Mark Zuckemberg confirmó que los ‘chatbots’ sustituirán en breve a muchos seres humanos que atienden el servicio al cliente en la mayoría de empresas. Aseguró que Facebook tiene planes para que pronto empiecen a funcionar, pero lo interesante será que los ofrecerán para que todas las compañías del mundo los puedan usar para vender cualquier cosa: seguros o gafas de sol.

Atendiendo a que las promesas que hace Facebook en su conferencia anual se cumplen -recordemos que el año pasado aseguraron que convertirían su plataforma Messenger en un centro para el comercio electrónico, productividad e integraciones con Uber para contratar taxis desde Messenger, con Spotify para compartir listas de reproducción, con KLM para hacer la gestión de tarjetas de embarque y con Dropbox para compartir archivos- podríamos interpretar que este es el nuevo reto que se cumplirá.

Que Facebook ponga en marcha procesos vinculados a la implementación de la Inteligencia Artificial es, dentro de lo que cabe, lógico. Tiene capacidad para investigar, comprar e implementar. Sin embargo detrás de esta ‘normalización’ inminente del uso de este tipo de operadoras artificiales e inteligentes, se esconde un paso más hacia la aceptación global de un escenario sociológico inmediato: la coexistencia entre humanos y máquinas cada vez más inteligentes hasta el punto que ‘conversaremos’ con ellas olvidando en ocasiones que no son ‘como nosotros’.

Facebook tiene previsto que cuando utilicemos Messenger para interactuar con KLM o Uber por ejemplo, en realidad lo hagamos con un robot. Zuckemberg explicó ayer que ya están siendo utilizados en casos como los artículos que envía CNN a los usuarios o el de 1-800 Flowers que entrega flores con mensajes personalizados artificialmente.

Que una empresa utilice este tipo de automatismos en el servicio al cliente es importante, que lo haga una empresa cuya ‘clientela’ asciende a 900 millones de personas es algo trascendental. En ese sentido el vicepresidente de la compañía explicó también que ‘los motores de búsqueda pueden proporcionar contenidos sobre el clima, actualizaciones de tráfico, recibos o notificaciones de envío. La operativa comercial de Facebook es visionaria y, con toda seguridad, será muy rentable. Existen más de 50 millones de empresas que utilizan Messenger para comunicarse con sus clientes en la actualidad. Me quedo con el hecho de que empezamos a asumir cierto grado de Inteligencia Artificial como normal, razonable y potencialmente viable. Está abandonando el territorio de la 'ciencia ficción'.

El crecimiento de Messenger, de quien hablé hace unos días cuando me refería a la eliminación del número de teléfono, es espectacular. En iOS es la segunda App más descargada y la de mayor crecimiento en USA. En este tema de la robotización del servicio al cliente y la rentabilidad de la inteligencia artificial aparece claramente una apuesta por liderar el tráfico y relaciones entre empresas. Cuantos más servicios aportes mayor será la cuota de mercado que alcances. No son únicos, pero si son los primeros en apostar claramente por un modelo de acercamiento al público en general de este salto al futuro.

El estado del asunto no tiene tanto que ver con la evolución tecnológica. Esa está descontada que acelerará. Todos los elementos así lo confirman. El tema es sociológico, ético en algunos casos y de carácter humanista. ¿Cuándo estaremos preparados como especie para compartir espacios de relación y conversación real con máquinas pensantes? ¿Cuándo nos dará igual conversar con ‘algo’ independientemente de que sea un humano o un robot? Esa barrera mental todavía latente irá reduciéndose como lo hicieron otros aspectos de nuestra vida. Memoricemos con que interactuamos ahora, con que objetos nos relacionamos que hasta hace poco tenían a un humano en su lugar.

Probablemente el método por el cual nos acostumbraremos a ese modelo de relación tendrá más que ver con el desconocimiento que con la comparación. En múltiples ocasiones vamos a estar interactuando con un software o una voz sintética y no lograremos diferenciarla de un ser humano. Ahí se iniciará el irreversible proceso del que Facebook quiere ser uno de sus líderes. ¿Está la inteligencia artificial en condiciones actualmente de dar ese salto?

¿Es capaz el desarrollo actual de ofrecer respuestas reales en situaciones complejas o difíciles? Veamos, actualmente se investiga en campos como la resolución de problemas por búsqueda, la búsqueda clásica llevada más allá, la búsqueda de resolución de problemas por comparación, la resolución satisfactoria de problemas constantes, el razonamiento y conocimiento aplicado a agentes lógicos, orden lógico, interferencias lógicas, planificación por representación del conocimiento, cualificación de lo incierto, razonamiento por probabilidades, razonamiento por probabilidades fuera de tiempo, aprendizaje desde los ejemplos, aprendizaje con modelos de probabilidades, proceso de lenguaje natural, comunicación final de lenguaje natural, percepción volumétrica, percepción de sentidos simulados, percepción de valores éticos, planteamientos filosóficos aplicados a la matemática y algoritmos de respuesta no dependientes.

Los campos de la Inteligencia Artificial son muchos más. Son apasionantes y seguramente aun estamos lejos de cuanto va a pasar. Si bien hay experiencias muy interesantes como Watson de IBM, hay todavía espacios enormes por recorrer. Stuart J. Russell asegura que 'si comparamos la situación actual de la AI con la que teníamos apenas hace 30 años, una manzana sería lo que sabíamos hace una década de Inteligencia artificial, el globo terráqueo lo que sabemos ahora y lo que vamos a saber en 5 tendría el tamaño del sistema solar.'

Recordemos el curioso caso de Tay, el chatbot que Microsoft puso en Twitter bajo un perfil de raciocinio ‘milenial’ y que tiene cerca de 207.000 seguidores y cuya función era aprender del resto de compañeros generacionales y parecerse lo más posible a ellos. En apenas 24 horas, Tay se encontraba en una discusión monstruosa. De hecho Microsoft tuvo que bloquear la cuenta y convertirla en privada a fin de no dañar más sus relaciones públicas. Tay se convirtió en una especie de robot misógino, racista y despiadado.

Tay, que nacía con género femenino, fue diseñado para conversar con los usuarios y aprender por imitación copiando patrones de habla. Se suponía que sólo imitaría personas de entre 18 y 24 años. Sin embargo cuando entró en debate con usuarios del foro 4chan éstos le enseñaron a tuitear frases como ‘I fucking hate feminists and they should all die and burn in hell’. No hace falta traducirlo.

La experiencia demuestra que la IA todavía tiene mucho camino por recorrer pero también se puede hacer una lectura distinta. Los robots no serán mucho más que un reflejo de lo que nosotros somos. Tal vez, antes de ponernos a diseñar modelos de respuesta automatizada e inteligente de nuestros servicios, pensemos en que ofrecemos realmente y que papel jugaremos nosotros en todo ese nuevo y flexible escenario. Si no lo hacemos corremos el riesgo que tras unas órdenes binarias, un robot pase a tener instinto, juicio y capacidad de tomar decisiones que bien pudieran ser tan absurdas, ineficientes y crueles como las que toma la especie humana a menudo.

En breve, la estrategia será humana y la táctica pura Inteligencia Artificial.

Bob Dylan le preguntó a la computadora Watson si había leído todas sus letras. El software le respondió que podía leer más de ochocientos millones de páginas por segundo y le indicó que las temáticas más utilizadas por el artista solían ser el paso del tiempo y los problemas con el amor. El video de esta conversación está embebido aquí abajo. Es especialmente divertido escuchar a Watson decir que ‘nunca ha conocido el amor’ y la propuesta de Dylan de componer algo juntos.

Bob Dylan le preguntó a la computadora Watson si había leído todas sus letras. El software le respondió que podía leer más de ochocientos millones de páginas por segundo y le indicó que las temáticas más utilizadas por el artista solían ser el paso del tiempo y los problemas con el amor. El video de esta conversación está embebido aquí abajo. Es especialmente divertido escuchar a Watson decir que ‘nunca ha conocido el amor’ y la propuesta de Dylan de componer algo juntos.

Dejando de lado esta anécdota simpática que surge de una serie de ‘spots’ publicitarios en la que personas conocidas mantienen conversaciones con el cerebro artificial Watson, lo destacable sigue siendo el estado de evolución del proyecto. Y es que este computador no es uno en si mismo, es un software que empieza a tener diversas versiones y fórmulas de utilización. De hecho no se programa como una computadora tradicional sino que aprende del lenguaje natural de las personas y ya lo hace de modos diversos y en diferentes estadios y elementos que lo complementan de manera global.

Ya hemos hablado de él y de cómo se está desarrollando en ámbitos paralelos. Watson nació hace años con una inversión brutal de más de mil millones de dólares llegando a convertirse en una unidad específica de negocio para sus creadores, IBM Watson. Allí, centenares de desarrolladores trabajan para aportar soluciones en inteligencia artificial para el healthtech, fintech, IT y servicios.

Evoluciona rápido. Hasta hace muy poco Watson no podía generar imágenes. Sólo las podía ‘ver’ y procesar. Para evitarlo IBM compró por otros mil millones a Merge Healthcare, una empresa especializada en captación de imágenes médicas. Una compra que se suma a las que ya hizo con Phytel y Explorys este mismo año para reforzar las debilidades del super computador.

Estas cifras son un claro ejemplo de lo que se pretende con la Inteligencia Artificial. IBM no es una ONG, obviamente está desarrollando su factor nuclear de negocio para el futuro inmediato. La computación cognitiva es, claramente, una de las apuestas más importantes para el gigante azul. Las grandes corporaciones de este planeta siguen situando sus piezas en un puzzle complejo de innovación difícil de predecir. Coches automáticos, logística sin humanos, robotización de procesos o eliminación de intermediarios. Los nombres que hay detrás son empresas, sólo empresas. Google, Apple, Uber, Tesla, Amazon y otros.

Durante un almuerzo hace pocas semanas, el director para la zona mediterránea de IBM, pude conocer parte del plan de desarrollo corporativo de la empresa. Me explicó que éste pasaba por la computación cognitiva en gran medida. Tienen claro que la tecnología ya está preparada para dar un salto de gigante en los próximos cuatro o cinco años. De hecho los datos que manejan confirman que en 2020, en apenas cuatro años, el universo digital en su totalidad equivaldrá a casi 1.600 millones de años de video en alta definición.

La aventura de IBM no es distinta a la de otras grandes corporaciones que se han lanzado a la conquista de ese espacio que nuestra mente es incapaz de abarcar y por eso, algunas, están desarrollando tecnologías cognitivas para analizar esos volúmenes bíblicos de información sin estructura. Cuando lo logremos emergerá el mayor volumen de conocimiento jamás visto.

Sin dejar IBM y gracias a su conocido sistema Watson, está desarrollando una aplicación inteligente que permita en el futuro próximo funcionar como asesor tecnológico para pequeñas y medianas empresas e, incluso, pueda ser utilizado para su desarrollo por parte de incipientes startups.

La Universidad Politecnica de Madrid ha iniciado un proyecto para ‘entrenar’ a Watson dentro del programa internacional "Shared University Research" junto a otras 45 universidades de todo el mundo. Es un interesante método de innovación. Una empresa ofrece sus recursos e investigadores y los pone a servicio de los equipos de investigación de las principales universidades del planeta en esta materia. Todos ganan.

Lo más importante no es el punto final, en este caso lo determinante es el camino a recorrer. Mientras se llega o no a los más altos grados de inteligencia artificial, el plan es ir recorriendo etapas que vayan ofreciendo resultados tangibles y que puedan ser utilizados no sólo por grandes empresas, instituciones o centros de investigación. El objetivo es que este derivado de Watson “sea capaz de responder a preguntas complejas en materia de estrategia tecnológica, a modo de asesor que oriente a las pymes para sacar el máximo partido de las tecnologías de la información en el desarrollo de su negocio”.

Me interesa saber como la inteligencia artificial va a sustituir a los directores de marketing. Ya lo están haciendo en algunos comicios electorales. No nos lo dicen, pero algunos directores de campaña ya no son humanos. Otro día hablaremos de esto, de sistemas inteligentes ordenando acciones en plena campaña y pasando por encima de criterios 'tradicionalmente' humanos.

Llegará, sino lo ha hecho ya, el momento en el que un sistema inteligente artificial será capaz de poner en marcha sus propias recomendaciones sobre una campaña, promoción o acción en un mercado concreto. Por ahí va. En teoría esto debería servir para que los gestores de un negocio puedan focalizar en la estrategia y no en la acción táctica.

¿Vamos hacia un escenario donde un humano marque la estrategia y a un cerebro artificial aplique la táctica? Tengo claro que si y por eso desde Idodi Venture Capital apostamos hace unos meses por una de las startups más prometedoras en estrategia competitiva y análisis comercial predictivo, Kompyte.

Así nos verá nuestro propio coche autónomo en breve

La semana pasada un coche sin conductor recorrió una distancia de 599 Km. Salió de Vigo y llegó a Madrid. Durante el recorrido el vehículo ajustó su circulación en base a límites de velocidad, movimientos de otros coches y características de la carretera. Se trataba de un PSA Peugeot Citroen y repetía una prueba ya realizada entre París y Burdeos hace unos meses.

La semana pasada un coche sin conductor recorrió una distancia de 599 Km. Salió de Vigo y llegó a Madrid. Durante el recorrido el vehículo ajustó su circulación en base a límites de velocidad, movimientos de otros coches y características de la carretera. Se trataba de un PSA Peugeot Citroen y repetía una prueba ya realizada entre París y Burdeos hace unos meses.

Lo interesante del asunto no es tanto que lo lograra sino los primeros pasos en el cambio de normativas que permitan este tipo de simulacros. De hecho esta primera prueba en España necesitaba de una autorización de la Dirección General de Tráfico que llegó a tiempo. Lo que abre un nuevo escenario a seguir probando e, incluso, a que cualquier marca o proyecto en marcha que quiera aplicarlo al campo real pueda hacerlo.

Cada vez está más cerca y seguramente es cuestión de mucho menos de lo que pensamos que este tipo de vehículos circulen tranquilamente por nuestras carreteras. Tengo la impresión, no obstante, que la puerta de entrada no será el vehículo particular sino el colectivo.

De hecho pronto se podrán ver, dicen que en la primavera próxima, autobuses autónomos por las calles de Suiza. Será uno de los primeros ensayos mundiales de un vehículo colectivo autoconducido en la vía pública.

Estos vehículos han sido creados por BestMile y empezarán en la ciudad de Sion, en el cantón de Valais, lo que ya ha despertado las primeras protestas en el colectivo de transportistas y taxistas por cierto.

Se ha decidido legalmente que el período de prueba de este tipo de transporte sin conductor sea de dos años. Sólo tendrá permiso para desplazar un máximo de nueve personas y sólo lo hará en zonas turísticas del casco antiguo de la ciudad.

BestMile es una empresa que apenas tiene un año de vida y ha sido creada por estudiantes de la EPFL de Laussana que han logrado desarrollar algoritmos que permitirán a estos autobuses a desplazarse identificando obstáculos sin intervención humana.

La novedad es que una hipotética flota de este tipo de autobuses autónomos funcionarían como lo hacen los aviones. Estarán controlados por una especie de ‘torre de control’ que permitirá la intervención humana ante cualquier necesidad.

Aseguran que la prueba no precisará de este elemento al principio al tratarse sólo de dos vehículos, pero que de cara al futuro esta puede ser una muy interesante transición hacia un mundo de coches y autobuses autónomos con la sola intervención del hombre en lo que sería la supervisión del tráfico. De esto también, algún día, se harían cargo algún tipo de sistemas inteligentes independientes de personas.

Como siempre, el negocio está detrás de todas las evoluciones. Uber ha comunicado su voluntad de adquirir medio millón de vehículos autónomos para uso individual. Google, Apple y Tesla siguen con sus programas de desarrollo de coches sin conductor. Es muy notable el salto y la velocidad que está tomando todo. Las autorizaciones a probar e suceden y la legislación va bajando el listón como hiciera ya en algunos casos con el tema de los ‘drones’.

Los conductores de autobuses suizos ya se han puesto en alerta aunque de momento siguen opinando que los huanos siempre serán necesarios.

Para saber como es lo que ve un coche autónomo, cual es el modo por el que se guía para identificar su modo de conducción, el proyecto ScanLab ha publicado lo que ‘los ojos’ de un coche autónomo ve. Se trata de identificar peatones, volúmenes, semáforos y dificultades imprevistas. No es tanto un geoposicionamiento, es una integración en el espacio e identificar que tienen y que no delante.

Como decía, el Proyecto Scanlab nos ha mostrado gracias a un escáner láser en un Honda CR-V circulando por las calles de Londres. Aunque el coche estaba conducido por un humano, el ‘Light Detection and Ranging’ informaba de todo cuanto veía del mismo modo que lo hace un coche autónomo. Es como un radar o un sónar, mide tiempos, espacios y localizas objetos. Todo ello es gestionado por un software que actúa en consecuencia a tiempo real.

Os dejo con el video del New York Times que combina este sistema LIDAR con la de la propia ciudad. Así nos verá nuestro coche en breve.

Inteligencia artificial: 'su desayuno señor'.

Está claro que 2015 habrá sido el año de los avances en Inteligencia Artificial. Mucho más de lo que podemos saber incluso. Se están haciendo cosas de pura ciencia ficción y que aun no tenemos constancia de ellas. Comentaban en ese acto que hoy en día ese aumento de inteligencia tecnológica se está produciendo a partir del aprendizaje automático, de la visión artificial y de la computación cognitiva, mezclándose entre si con nuestras vidas digitales.

La semana pasada asistí a varios encuentros durante el WebSummit de Dublín que permitían imaginar como sería el futuro inmediato. Directivos de las principales multinacionales tecnológicas del mundo se dieron cita para explicar que estaban haciendo en diferentes campos. Entre ellas destacó la reunión con Paul Daugherty, CTO de Accenture.

De hecho Accenture ha empezado a invertir una parte de los casi 25 millones de dólares que tiene presupuestados para la creación de un nuevo centro de Innovación en la capital irlandesa y que dará empleo a más de 200 personas. El espacio en el que piensan especializarse es en el de la Inteligencia Artificial.

Daugherty sabe mucho de esto y además teoriza sobre hacia donde va la llamada AI. Concretamente su discurso suele centrarse más en la convivencia entre robots, inteligencia artificial y avances tecnológicos que en el hecho de que esta tecnología pudiera eliminar irremediablemente puestos de trabajo.

Me quedé con alguna de sus reflexiones acerca de que ‘la inteligencia artificial servirá para capacitar a las personas del futuro a fin de que puedan realizar el trabajo más cualificado, pero para nada estaremos hablando de ‘súper humanos’. Según él ‘el verdadero poder de la inteligencia artificial está en aumentar lo que los humanos son capaces de hacer y en mejorar el modo en el que lo hacen y, en consecuencia, sus resultados.’

Está claro que 2015 habrá sido el año de los avances en Inteligencia Artificial. Mucho más de lo que podemos saber incluso. Se están haciendo cosas de pura ciencia ficción y que aun no tenemos constancia de ellas. Comentaban en ese acto que hoy en día ese aumento de inteligencia tecnológica se está produciendo a partir del aprendizaje automático, de la visión artificial y de la computación cognitiva, mezclándose entre si con nuestras vidas digitales.

Empezamos a vivir con asistentes digitales con cierta naturalidad. Siri en tu iPhone o el anunciado respondedor de Gmail que en breve tendremos oportunidad de utilizar. En esa conviviencia, según Daugherty, no está la sustitución de empleos, o por lo menos no sólo, sino que también aparece el ‘empoderamiento’ de los seres humanos para ser más brillantes y eficaces.

En ocasiones la Inteligencia Artificial nos parece algo frío, robótico, alejado de nuestro modo de vida convencional y nos asusta. Sin embargo, a pesar de que tengo reparos acerca de cómo lo vamos a organizar, de cómo nuestros gobernantes van a estructurar legalmente y socialmente todo este desembarco inevitable, interpreto que la Inteligencia Artificial no será más que un nuevo modo de crear capacidades, comprender nuestros objetivos y tomar decisiones ayudados por sistemas expertos y, obviamente, más inteligentes.

Tengo claro que prometer empleo antes de unas elecciones para los próximos cuatro años es una quimera y un brindis al Sol. Nadie sabe a ciencia cierta que va a pasar en ese período y en todo caso el empleo como concepto irá tomando un nuevo cuerpo. O habrá menos empleo o éste será completamente distinto. Recordemos como era todo hace una legislatura, sea dónde sea. En poco menos de un lustro cambia todo a una velocidad que sorprende. Hace cuatro años no se hablaba con naturalidad de decenas de avances que ahora se han naturalizado y ni se nombraban otros que ya se interpretan inminentes.

El futuro pasa por regular las diferencias entre todos. La tecnología nos va a permitir trabajar menos y con ello a ser más productivos. Seguramente esto pasa por pagar más impuestos y aceptar un mundo ocioso. No sé, no lo tengo claro. Si hablas de repartir te tildarán de izquierdas, si hablas de libertad económica serás de derechas. La inteligencia artificial no entenderá de opciones políticas ni de ideologías, sólo volcará datos, los administrará y ofrecerá resultados, conclusiones.

Esas conclusiones podrían ser muy distintas a como ahora imaginamos un mundo automatizado, tal vez, un lugar dónde los límites se estrechen y dónde soportar una sociedad envejecida y de escaso valor productivo se deba sujetar en un reparto más justo y sostenible. No parece muy ‘inteligente’ que en 2016, según Intermon Oxfam, el 1% más rico tenga más que el resto de la población mundial sumada. Tal vez es justo, tal vez es aceptable, pero no parece muy sostenible.

El futuro estará cargado de cambios en como entendemos la AI. Durante 30 años hemos vivido avances interesantes pero es ahora que éstos son realmente determinantes. En breve vamos a ver los verdaderos avances y nos vamos a quedar como si viéramos una aparición. La AI actualmente ya trabaja en crear sistemas más rápido, resolver problemas incompatibles con el cerebro humano e incrementar los procesos de innovación absolutamente inéditas.

Sin embargo coincido con el directivo de Accenture cuando comenta que tenemos una visión de la AI muy cercana a la que la cinematografía nos ha ido dando y no es así. No vamos en camino de crear seres sobrenaturales, casi perfectos, sino que a lo que se está dirigiendo toda la investigación y logros es a aumentar habilidades para todos nosotros.

Puso un ejemplo. Se trataba de un robot inteligente que se comporta como una derivación humana, que permite utilizar la visión aumentada, la realidad virtual, el aprendizaje computacional predictivo y la gestión de datos masiva, logrando que trabajadores sin una cualificación extraordinaria puedan realizar tareas hasta ese momento imposibles para ellos.

En Inteligencia Artificial los avances más destacados, y que en breve vamos a tener conocimiento genérico, que me explicaron parten de la asistencia sanitaria donde los fabricantes de medicamentos, de los análisis clínicos, de las conclusiones médicas en segundos, de la fabricación de cualquier de estructuras, de la tecnología de aviones no tripulados, de la eliminación de errores en la cadena de valor, de oportunidades empresariales que deberían crear tiempo libre.

Le hice una pregunta sobre ese hipotético tiempo libre. Su respuesta fue que los humanos gastaremos mucho tiempo en ‘consumir’. Que lástima, con la de cosas que se puede hacer con el tiempo que nos regalará el hecho de que un cerebro artificial piense por nosotros en cosas que nosotros no somos tan eficientes o no queremos pensar. Igual todo esto al final resultará ser lo contrario de lo que define la palabra inteligencia. Dependerá de nosotros esencialmente.

Independientemente de esa respuesta imagino que lo que toca es experimentar y cometer errores. Acerca de nuestra relación como especie con un mundo de silicio y con un sistema inteligente global que se va instalando. Nos tocará adaptarnos y entenderlo, aceptar lo que pueda ser beneficioso y pelear contra lo que nos siga pareciendo incorrecto. No por moderno tiene que ser mejor. La tecnología debe estar a nuestro servicio y aportar valor real.

A veces dan ganas de buscarse una casa en Donegol y refugiarse allí, con el viento y el frío, con sus pescadores y sus vidas de wi-fi intermitente. El fuego en la chimenea y un montón de libros en papel. Dejar de lado tanta red social y volver a los orígenes, a las conversaciones de bar, a las cartas de papel, a esa espera de días hasta recibir la respuesta. Dan ganas ciertamente. Lo curioso es que cuando te imaginas esa vida analógica, lenta, creativa y de madera, aparece al final del sueño, tras la puerta, dando un golpecito metálico, un robot femenino (lo siento lo imagino así) que te trae las tostadas con mantequilla y la mermelada con un café caliente diciendo ‘su desayuno señor’.

Robot de compañía entre la IoT, la domótica y el M2M.

Antes del video que acompaña este post, permitidme una reflexión previa. Mientras nos informan que el paro baja, la brujas se peinan y la vida se arregla a marchas forzadas, el lugar donde pasan las cosas cada vez está más lejos. Los datos del paro de ayer en España por buenos que son a primera vista son un desastre monumental en cuanto a lo que significa.

Antes del video que acompaña este post, permitidme una reflexión previa. Mientras nos informan que el paro baja, la brujas se peinan y la vida se arregla a marchas forzadas, el lugar donde pasan las cosas cada vez está más lejos. Los datos del paro de ayer en España por buenos que son a primera vista son un desastre monumental en cuanto a lo que significa. Cada vez menos opciones de que nuestros hijos y nietos puedan atender una conquista imprescindible de un mundo tecnológico y capaz de ser competitivo. Se crea empleo en lo que se crea. En España el nuevo empleo, precario y vinculado a servicios se lleva el 70% de esa nueva ocupación. En Irlanda, por poner un lugar que conozco, el 50% del nuevo empleo está ubicado en la sociedad del conocimiento y tecnologías asociadas. En ese mundo al revés hay un nuevo actor. El robot familiar. Y detrás de él empresas y empleos que se tienen que crear. Unos los crean y otros no. De esto va conquistar el futuro. Hoy vamos a ejemplificar con uno más de los que ya existen. No representa novedades tecnológicas, sino más bien psicológicas o de comportamiento e interactuación con él.

Las empresas que están trabajando en el campo del ‘robot de compañía’ aumentan. Digamos que el paisaje doméstico es uno de los campos de investigación y propuestas más sorprendentes de cuanto la conocida ‘IoT’ nos puede aportar en lo más cotidiano. Sabemos que no es inteligencia artificial, de hecho, en gran medida dista mucho de lo que sería el M2M o diálogo real entre máquinas, pero no deja de ser interesante observar la evolución de los proyectos que se van convirtiendo en empresas y en como objetos cada vez más sofisticados solicitan ser parte de la familia. A esto se le ha ido llamando ‘la transición’, algo así como el tiempo que transcurrirá entre la vida como ahora la conocemos y la que interactuará con todo tipo de objetos al servicio de nuestra especie. O eso parece.

Destaco hoy la empresa Blue Frog Robótica, una startup con la que tuve ocasión de compartir un fin de semana en un evento organizado por Google Entrepreneur. De momento es un prototipo que en breve estará a la venta. Su definición es la de robot acompañante para niños, personas mayores o familia en general.

De hecho Blue Frog se inspira en el robot NAO de Bruno Maisonnier que ya saliera al mercado en 2006 y que, aunque más pequeño ‘hablaba’ con humanos y te acompañaba por la casa como un perrito faldero. Desde entonces, los ‘acompañantes robot’ se han ido multiplicando. Ahora se pueden comprar unos 21 modelos distintos que van de una especie de plato con ojos a una mascota virtual. Parece un juego, pero no lo es tanto. Hay modificaciones en psicología de las relaciones que están estudiando que sucede cuando un artefacto de estos entra en la vida de una familia como ya sucede en el día a día de muchas empresas.

La novedad que aporta Buddy parte de las opciones que aporta y el método que utiliza en la relación humano-máquina. Estructura la vida si te dejas. El comportamiento del bicho y el como se altera o no la vida de una familia en base a su presencia es lo que me hace reflexionar. ¿Afectará a nuestra vida cotidiana un objeto inteligente y complementario como lo han hecho los teléfonos móviles o la propia Internet? ¿Es el embrión de un modo de vida completamente distinto? ¿Cuánto tiempo precisaremos para naturalizarlo?

Buddy pesa 5 Kg. y mide algo más de medio metro. Su aspecto es simpático y es capaz de integrarse en la vida moderna de cualquier familia. No necesita programación ni accesorios, viene ‘perfecto’ de fábrica. Colabora con las tareas de la casa, recuerda eventos, te despierta, te hace fotos, contesta llamadas y vela por la seguridad de la casa.

Se conecta via Wifi y bluetooth a cualquier cosa conectable. Altavoces, cámaras, sensores térmicos, de movimiento y una pantalla frontal que muestra su ‘estado de ánimo’ modificando los rasgos faciales con un sinfín de gestos y expresiones como respuesta a cada estímulo recibido. Dispone de 16 GB de almacenamiento interno y una autonomía de unas 10 horas gracias a la batería de Ion-litio que lo alimenta.

El software de audio y vídeo también permitirá registrar e identificar a los miembros de la familia para detectar la presencia de extraños, así como interpretar el lenguaje humano para comunicarse verbalmente con familiares y amigos. Realmente estamos ante algo más parecido a la domótica que a la IoT o, talvez, una combinación futurista y visionaria de las dos. Un dispositivo doméstico de seguridad que nos permitirá entre otras cosas, verificar si hemos apagado el horno correctamente, si tenemos una fuga de agua o simplemente controlar dispositivos básicos del hogar como termostatos, cerraduras o interruptores.